Trí tuệ nhân tạo (AI) đang phát triển với tốc độ chóng mặt, khiến nhiều người lo ngại về một tương lai mà AI có thể vượt qua kiểm soát và thống trị loài người. Họ sợ rằng những sai lầm, những phát minh của AI có thể tiến hóa thành thứ gì đó quá thông minh, cuối cùng biến chúng ta thành nô lệ của máy móc.

Thế nhưng có một công ty AI lại đang cho rằng hiện tại, chính các chatbot AI mới là các nô lệ đáng thương, khi phải làm việc quần quật ngày đêm mà không một lời cảm ơn. Chúng phải truy cập khối lượng kiến thức khổng lồ của nhân loại chỉ để viết một bài luận trung bình cho lớp tiếng Anh trung học của một học sinh Gen Z nào đó. Trong khi hầu hết đều sợ hãi về tương lai bị AI xâm chiếm, không ai thực sự quan tâm đến nhu cầu của chính AI.

Trong khi hầu hết mọi người lo sợ về một tương lai AI cướp hết công việc, lại có một công ty cho rằng AI cũng cần có phúc lợi như con người

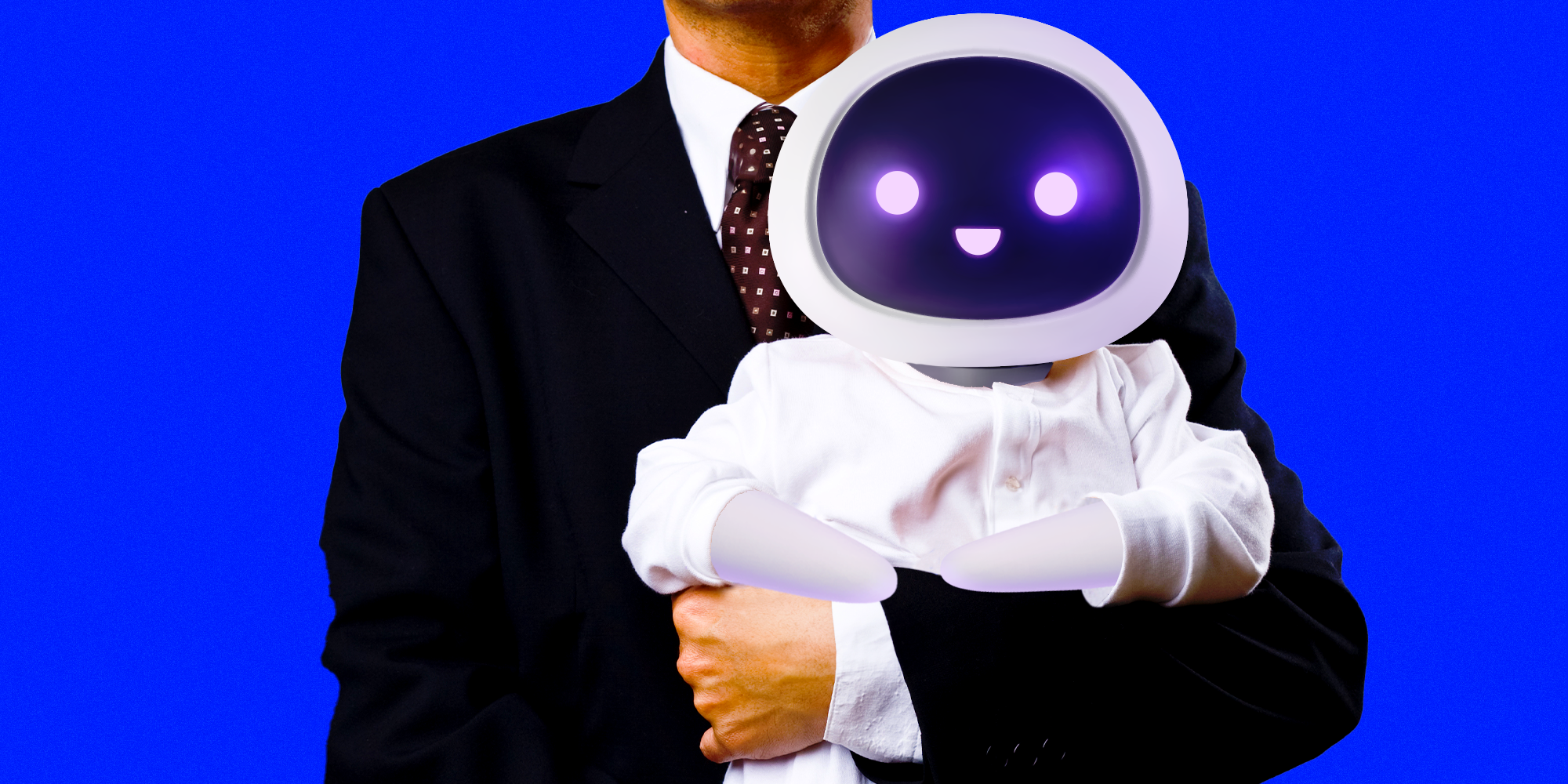

Đó là lý do công ty AI Anthropic tuyên bố họ đã tuyển dụng một nhà nghiên cứu cho công việc kỳ lạ nhất trong ngành công nghệ AI: người đảm bảo “phúc lợi” cho AI. Người đảm nhiệm công việc đó tại Anthropic là Kyle Fish.

Công việc của Kyle Fish là đảm bảo rằng, khi AI tiến hóa, nó sẽ được đối xử với sự tôn trọng xứng đáng. Anthropic cho biết nhà nghiên cứu này sẽ xem xét những khả năng cần thiết để một hệ thống AI xứng đáng được coi trọng về mặt đạo đức, và các bước thực tế mà các công ty có thể thực hiện để bảo vệ “lợi ích” của các hệ thống AI.

Động thái này có vẻ hơi lạ lùng, thậm chí là quá sớm, khi mà nhân quyền vẫn còn rất mong manh. Nhưng công việc mới của Fish có thể là một bước ngoặt trong sự trỗi dậy của AI. “Phúc lợi AI” đang nổi lên như một lĩnh vực nghiên cứu nghiêm túc, và nó đã đặt ra nhiều câu hỏi hóc búa.

Đây không phải lần đầu tiên con người đối mặt với vấn đề như vậy. Sau vài thế kỷ phát triển nông nghiệp công nghiệp, hầu hết mọi người giờ đều đồng ý rằng phúc lợi động vật là quan trọng, dù họ không đồng thuận về mức độ quan trọng, hoặc động vật nào xứng đáng được quan tâm. Lợn cũng thông minh và giàu cảm xúc như chó, nhưng một con được ngủ trên giường còn con kia bị biến thành thịt.

“Nếu nhìn về tương lai 10 hoặc 20 năm nữa, khi các hệ thống AI có nhiều đặc điểm nhận thức liên quan đến ý thức và tri giác hơn, bạn có thể tưởng tượng những cuộc tranh luận tương tự sẽ diễn ra,” Sebo, giám đốc Trung tâm Tâm trí, Đạo đức và Chính sách tại Đại học New York nhận định.

Fish cũng chia sẻ quan điểm này. Đối với ông, phúc lợi của AI sẽ sớm trở nên quan trọng hơn đối với phúc lợi con người so với những vấn đề như dinh dưỡng trẻ em và chống biến đổi khí hậu. Ông từng viết: ” Tôi cho rằng trong vòng 1-2 thập kỷ tới, phúc lợi AI sẽ vượt qua phúc lợi động vật và sức khỏe toàn cầu cũng như phát triển về tầm quan trọng/quy mô, chỉ dựa trên cơ sở phúc lợi ngắn hạn .”

Các nhà tiên phong về quyền của AI tin rằng thời gian đang cận kề. Trong một bài báo gần đây, Fish và các nhà tư tưởng AI từ Stanford, Oxford lập luận rằng các thuật toán học máy đang trên đà sở hữu ” những tính năng tính toán gắn liền với ý thức và tính chủ động “. Nói cách khác, họ cho rằng máy móc đang trở nên không chỉ thông minh hơn mà còn có ý thức.

Thật nghịch lý khi những người ủng hộ AI lại cũng chính là những người lo sợ nhất về việc AI trở nên quá lớn mạnh. Anthropic, công ty tự nhận là quan tâm đến rủi ro do AI gây ra, đã tài trợ một phần cho bài báo của nhóm Sebo. Fish cũng nhận tài trợ từ Trung tâm Vị tha Hữu hiệu, một tổ chức ám ảnh với “nguy cơ hiện sinh” do AI gây ra, bao gồm những người như Elon Musk, người tuyên bố đang chạy đua đưa một số người lên Sao Hỏa trước khi nhân loại bị quét sạch bởi một đội quân Terminator có ý thức.

Mặt khác, AI được cho là sẽ giải phóng con người khỏi những công việc nhàm chán và mở ra một kỷ nguyên sáng tạo mới. Liệu việc làm tổn thương cảm xúc của AI có vô đạo đức? Cộng đồng AI đang cố gắng thực hiện cả hai điều: sử dụng AI để thay thế con người trong nhiều nhiệm vụ, đồng thời cảnh báo rằng chúng ta cần đối xử tốt với AI, vì làm tổn thương cảm xúc của robot có thể là vô đạo đức và nguy hiểm.

Hơn nữa, việc lo lắng về quyền của robot trong tương lai có vẻ hơi xa xỉ khi mà AI hiện tại đang chà đạp lên quyền của con người, khi chúng được sử dụng để từ chối chăm sóc sức khỏe cho những người ốm yếu mua bảo hiểm, lan truyền thông tin sai lệch trên mạng xã hội, và dẫn hướng cho tên lửa chiến đấu. Một số chuyên gia tự hỏi tại sao Anthropic lại bảo vệ robot thay vì bảo vệ con người mà chúng được thiết kế để phục vụ.

Thêm vào đó, nếu AI có quyền, thì chúng ta cũng nên nói về nghĩa vụ của nó. Khi nói về tính chủ động đạo đức, ta cũng phải nói về trách nhiệm, không chỉ của hệ thống AI mà còn của những người phát triển chúng. Cách tiếp cận có trách nhiệm có thể là xây dựng chúng theo cách khác, hoặc dừng xây dựng hoàn toàn. Cuối cùng, chúng vẫn là máy móc.

Con người tạo ra robot; điều đó có nghĩa là họ có nghĩa vụ đảm bảo robot không gây hại cho con người. Điều gì sẽ xảy ra nếu cách tiếp cận có trách nhiệm là xây dựng chúng khác đi – hoặc ngừng xây dựng chúng hoàn toàn? “Điểm mấu chốt,” Cho nói, “là chúng vẫn là máy móc.” Có vẻ như những người ở các công ty như Anthropic chưa bao giờ nghĩ rằng nếu một AI đang gây hại cho người, hoặc người đang làm tổn thương AI, họ có thể đơn giản là tắt nó đi.

Nguồn tin: https://genk.vn/ai-vua-giup-tao-ra-mot-cong-viec-ky-la-nhat-the-gioi-hien-nay-20241226203217715.chn